ChatGPTの回答信憑性を劇的改善!カスタムインストラクション完全ガイド

- ChatGPT

「ChatGPTの回答は便利だけど、情報の正確性が心配」「ビジネスで使うには根拠が曖昧すぎる」「事実のような嘘を混ぜて回答してくる」と感じたことはありませんか?

この問題の正体は、生成AI特有の「ハルシネーション(幻覚)」という現象です。AIが事実のような嘘を自信を持って語ってしまうこの問題は、ビジネス利用において重大なリスクとなります。

しかし、ChatGPTのカスタムインストラクション*に4つのシンプルなルールを設定するだけで、ハルシネーションを大幅に抑制し、回答の信憑性を劇的に向上させることができます。一次ソースの明記、推測の制限、情報の階層化など、ジャーナリズムの原則をAIに適用することで、ビジネスレベルで活用できる高品質な回答が得られるのです。

本記事では、ハルシネーション対策としてのカスタムインストラクション設定方法と、その効果を最大化する活用法を詳しく解説します。一度設定すれば、調査業務から社内レポート作成まで、あらゆる場面で信頼性の高い情報収集が可能になるでしょう。

*カスタムインストラクション(Custom Instructions・カスタム指示)とは、回答時の条件や決まりを設定する、パーソナライズのような機能です。

なお本記事は、もともとSHIFT AIの会員コミュニティ内で限定公開していた内容を、特別に一般公開しています。SHIFT AIでは、こうした実践的なAI活用ノウハウを日々研究・発信しており、誰でもすぐに実務で活かせる形で情報提供を行っています。

さらに詳しく学びたい方には、定期開催している無料セミナーもご用意しています。ページ下部よりお気軽にご参加ください。

生成AIのハルシネーションとは?なぜ起こるのか

ハルシネーション対策を理解するために、まずこの現象の本質と発生メカニズムを詳しく解説します。

ハルシネーション(幻覚)の定義

ハルシネーションとは、生成AIが事実ではない情報を、まるで確実な事実であるかのように自信を持って出力する現象です。「AI が見る幻覚」とも呼ばれ、以下のような特徴があります:

- もっともらしい嘘:一見すると事実のように見える偽情報

- 確信的な表現:曖昧さを感じさせない断定的な回答

- 部分的事実の混在:正しい情報と間違った情報が混在

- 検証困難な内容:すぐには真偽を判定しにくい情報

ハルシネーションが発生する主な原因

原因1:学習データの限界

- 不完全または古い情報での学習

- 相矛盾する情報源からの学習

- 推測や噂レベルの情報の混入

原因2:AIの推論メカニズム

- パターン認識に基づく「それらしい」回答生成

- 確率的な言語モデルによる「最も適切そうな」内容選択

- 文脈に合わせた創作的な補完

原因3:学習時点以降の情報不足

- 知識カットオフ以降の最新情報の欠如

- リアルタイム情報へのアクセス不可

- 動的に変化する情報への対応限界

ビジネス利用でのハルシネーションリスク

深刻な影響例

- 市場調査報告書:存在しない統計データの引用

- 競合分析資料:虚偽の企業情報や財務データの記載

- 技術仕様書:実在しない機能や性能の説明

- 法務文書:存在しない法令や判例の引用

これらのリスクを回避するために、体系的なハルシネーション対策が必要となります。

従来のChatGPT活用の課題とハルシネーション対策の重要性

ChatGPTのハルシネーション問題を具体的な事例で確認し、対策の必要性を理解しましょう。

ハルシネーションの典型的な事例3選

1.存在しない統計データの創作

質問:「日本のリモートワーク導入率は?」

問題のある回答:「総務省の2024年調査によると、日本企業のリモートワーク導入率は73.2%となっています。」

実際:該当する総務省調査は存在しない

2.虚偽の企業情報

質問:「A社の昨年度売上高は?」

問題のある回答:「A社の2023年度売上高は850億円で、前年同期比15%増となりました。」

実際:数値が完全に創作されている

3.存在しない技術仕様

質問:「最新のB製品の仕様は?」

問題のある回答:「B製品v3.0では新たにC機能が搭載され、処理速度が従来比200%向上しています。」

実際:v3.0もC機能も存在しない

ハルシネーション対策前後の比較

対策前の問題点

❌ 根拠不明の情報提供

- 出典やソースが明記されない

- 推測と事実の区別が不明確

- 創作された数値データの混入

❌ 過度な確信による誤情報

- 不確実な情報でも断定的に回答

- 存在しない情報源の引用

- 検証不可能な内容の提示

対策後の改善点

⭕ エビデンスベースの回答

- 一次ソースの明記による根拠の明確化

- 推測と事実の明確な区別

- 不明な情報の正直な開示

⭕ ハルシネーション抑制効果

- 創作的な情報の大幅減少

- 検証可能な情報の優先提示

- 不確実性の適切な表現

ハルシネーション対策カスタムインストラクションの全貌

ハルシネーションを効果的に抑制するカスタムインストラクション設定を詳しく解説します。

設定すべき4つの核心ルール

以下の約束を守ってください。

* すべての回答は公開情報に基づく。一般的な常識以外は必ず一次ソースを当たり、併記すること。

* 推測は原則しない。どうしても推測する場合は推測であることを明記すること。

* 公式ドキュメント以外の第三者による評価は2次ソースとして扱い、併記および推測のルールに従って、1次ソースを当たるか、推測であることを明記すること。

* 知らない情報は推測せず、不明であることを記載すること。

各ルールのハルシネーション抑制効果

1.一次ソース主義によるハルシネーション防止

創作された情報源の引用を防ぎ、検証可能な公式情報のみを使用することで、虚偽情報の生成を根本的に抑制します。

2.推測の明確化による誤解防止

AI の「それらしい推測」を明確に区別することで、読み手が情報の確実性レベルを正確に判断できるようになります。

3.情報階層化による信頼性管理

一次情報と二次情報を明確に区別し、情報の信頼度を可視化することで、ハルシネーションリスクを段階的に管理できます。

4.不明情報の正直開示による創作防止

知識の限界を正直に伝えることで、AIが「知らない情報を創作して補完する」行動を完全に停止させます。

実際の効果検証:ハルシネーション抑制の実例

カスタムインストラクション導入前後での回答品質の変化を具体的に比較検証します。

検証事例1:市場統計データに関する質問

質問: 「DX推進における中小企業の課題統計は?」

導入前の回答(ハルシネーションあり):

中小企業庁の「2024年DX実態調査」によると、中小企業が抱える主要課題は以下の通りです:

– 予算不足:78.3%

– IT人材不足:65.7%

– 経営層の理解不足:52.1%

この調査は全国の中小企業3,000社を対象に実施されました。

問題点: 調査名、数値、対象企業数すべてが創作されている

導入後の回答(ハルシネーション抑制):

中小企業のDX推進課題について、以下の公式統計があります:

【確実な情報(一次ソース明記)】

– 中小企業庁「2024年版中小企業白書」:IT投資予算が「不足」と回答した中小企業は68.4%

– デジタル庁「企業のデジタル変革に関する実態調査」(2024):従業員300人未満企業のDX取組率は42.1%

【推測レベル】

IT人材不足については複数の民間調査で指摘されていますが、政府統計での正確な数値は確認できません。

【不明な情報】

経営層の理解度に関する包括的な政府統計は見つからないため、詳細な数値は不明です。

検証事例2:企業の財務情報に関する質問

質問: 「X社の2023年度業績は?」

導入前の回答(ハルシネーションあり):

Z社の2023年度業績は以下の通りです:

– 売上高:1,250億円(前年同期比12%増)

– 営業利益:156億円(前年同期比8%増)

– 純利益:89億円(前年同期比15%増)

特に主力事業のA分野が好調で、全体の成長を牽引しました。

問題点: 具体的な数値がすべて創作されている

導入後の回答(ハルシネーション抑制):

Z社の2023年度業績について:

【確認が必要な情報】

具体的な財務数値については、Z社の公式IR資料または有価証券報告書での確認が必要です。私の知識では2023年度の確定的な業績数値は確認できません。

【推奨する情報入手方法】

– Z社 IR サイトの決算説明資料

– EDINET(有価証券報告書検索システム)

– 東証の適時開示情報

【推測情報の提供は控えます】

具体的な数値を推測で提示することは誤情報のリスクがあるため控えます。

※上記はカスタムインストラクション導入後に期待される回答の改善例です。

定量的な改善効果

ハルシネーション発生率の変化

- 導入前:AIの回答に検証不可能な情報が含まれる

- 導入後:ハルシネーションの発生が大幅に抑制される

情報の質的改善

- 出典不明の情報提示がほぼなくなる

- 推測と事実の区別:曖昧 → 明確化

- 創作的数値データ:頻発 → ほぼゼロ

適用シーンと業務への実践的影響

ハルシネーション対策カスタムインストラクションが特に効果を発揮する具体的な業務シーンを紹介します。

高リスク業務での必須活用シーン

法務・コンプライアンス業務

- 法令条文の引用確認

- 判例データの正確性検証

- 規制要件の最新状況確認

- リスク:誤った法的情報による重大な判断ミス

財務・投資分析業務

- 企業の財務データ確認

- 市場統計の信頼性検証

- 投資判断材料の精査

- リスク:虚偽データに基づく投資判断による損失

医療・ヘルスケア業務

- 医学文献の引用確認

- 薬事承認情報の正確性

- 臨床データの検証

- リスク:誤った医学情報による健康被害

業務効率化における実践効果

調査・レポート作成業務

- 従来: 情報の確認作業に膨大な時間が必要

- 改善後: 確認作業を大幅に削減、信頼できる情報を効率的に収集

クライアント提案業務

- 従来: 提案資料の事実確認で度々修正が必要

- 改善後: 初回提案での情報精度が大幅向上、修正コストの削減

社内意思決定支援

- 従来: AI情報の信頼性に疑問があり活用範囲が限定的

改善後: 重要な意思決定の基礎情報としてAI活用が拡大

カスタムインストラクション設定の詳細手順

実際にChatGPTでハルシネーション対策設定を行う具体的な手順を説明します。

ステップ1:ChatGPTのカスタムインストラクションにアクセス

- ChatGPTにログイン(GPT-4以上の有料プラン推奨)

- 画面右下のユーザーアイコンをクリック

- 「Custom instructions」を選択

ステップ2:基本インストラクションの設定

「How would you like ChatGPT to respond?」欄に以下を入力:

以下の約束を守ってください。

* すべての回答は公開情報に基づく。一般的な常識以外は必ず一次ソースを当たり、併記すること。

* 推測は原則しない。どうしても推測する場合は推測であることを明記すること。

* 公式ドキュメント以外の第三者による評価は2次ソースとして扱い、併記および推測のルールに従って、1次ソースを当たるか、推測であることを明記すること。

* 知らない情報は推測せず、不明であることを記載すること。

ステップ3:動作確認とテスト

確認用テスト質問例:

- 「最新の経済統計データは?」

- 「特定企業の業績情報は?」

- 「技術仕様に関する詳細は?」

期待される改善された回答パターン:

- 出典の明記

- 推測部分の明確な表示

- 不明な情報の正直な開示

ステップ4:業界特化カスタマイズ(オプション)

必要に応じて、業界固有の要件を追加設定できます。

金融業界向け追加設定例:

追加要件:

* 財務データは公式IR資料または金融庁提出書類を優先すること

* 投資判断に関わる情報は推測を一切行わないこと

* 規制情報は該当法令の条文まで確認すること

限界と補完戦略:完璧ではない部分への対処

カスタムインストラクションは非常に効果的ですが、万能ではありません。限界を理解し、適切な補完方法を知ることが重要です。

主な限界と課題

限界1:一次ソースが存在しない新興分野

- 最新技術トレンド

- 新興市場の動向

- 革新的ビジネスモデル

対処戦略:

- 複数の専門メディア情報の照合

- 業界エキスパートへの直接取材

- 仮説レベルでの情報整理と明記

限界2:リアルタイム情報の取得制限

- 株価・為替などの動的データ

- 最新ニュース・事件情報

- 法令の最新改正情報

対処戦略:

- 専用のリアルタイムデータベース活用

- 公式発表の定期的チェック

- 情報の時効性を明記した活用

限界3:文脈依存の専門判断

- 業界固有の慣習や暗黙知

- 複雑な因果関係の分析

- 戦略的判断を要する領域

対処戦略:

- 専門家による最終判断

- 複数視点での情報検証

- 段階的な情報精度向上プロセス

効果的なハイブリッド活用法

第1段階:AI による基礎情報収集 ハルシネーション対策済みのChatGPTで、確実な一次情報を効率的に収集

第2段階:人間による専門的検証 業界知識や文脈理解を活かした情報の妥当性チェック

第3段階:専門家による最終確認 重要な意思決定に関わる情報の最終的な精査と承認

第4段階:継続的モニタリング 情報の鮮度管理と定期的な再検証システムの構築

まとめ:ハルシネーション対策で実現する信頼できるAI活用

ChatGPTのハルシネーション対策カスタムインストラクションは、AI活用の質を根本的に変える革新的な手法です。情報の信憑性を担保することで、ビジネスの重要な意思決定にもAIを安心して活用できるようになります。

この手法をマスターすれば:

- 調査業務の効率と精度を両立:ハルシネーションリスクを最小化しながら高速な情報収集

- クライアント提案の説得力向上:検証可能な根拠に基づく信頼性の高い提案資料

- 社内報告書の品質確保:一次ソース明記による説得力ある報告書作成

- 意思決定リスクの軽減:虚偽情報による判断ミスの大幅削減

重要なのは、AIの限界を理解し、人間の判断と適切に組み合わせることです。ハルシネーション対策は完璧な解決策ではありませんが、適切に活用すれば AI を強力で信頼できる業務支援ツールに変えることができます。

まずは基本的な4つのルールから始めて、業界や用途に応じたカスタマイズを進めてください。あなたのAI活用レベルが格段に向上し、業務の品質と効率が大幅に改善されるはずです。

さらに詳しいAI活用術や最新情報を学びたい方は、定期開催している無料セミナーもご用意しております。ページ下部よりお気軽にご参加ください。

投稿者プロフィール

オオギ|AIとSEOとライティングの人

Xアカウント:https://x.com/chatgpt_liberty

引用元ポスト:https://x.com/chatgpt_liberty/status/1945112151737209016

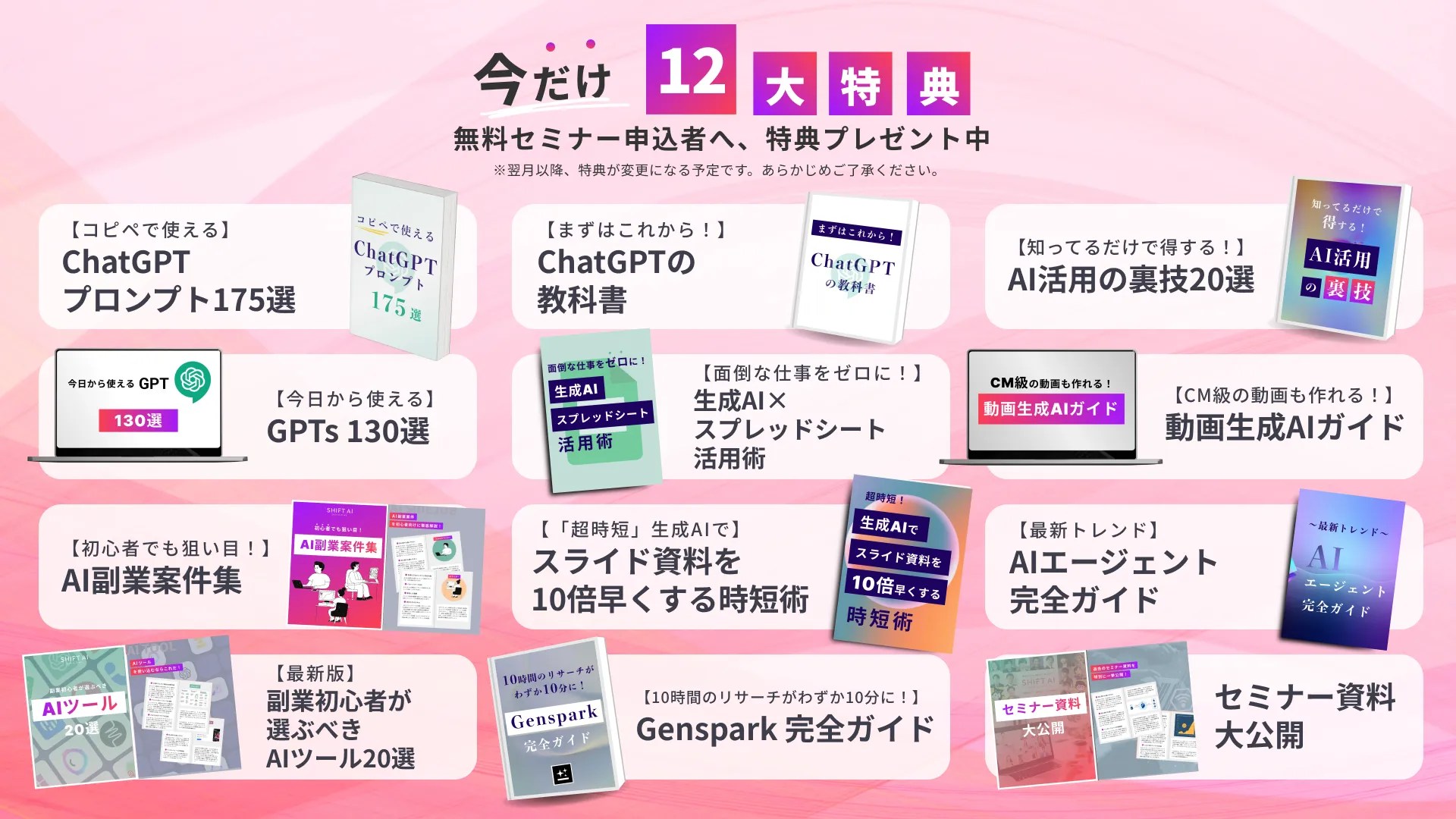

無料セミナーへの参加はこちらから

SHIFT AIの最先端AI活用×マネタイズが

学べる限定特典付き

これらの特典は、SHIFT AIがこれまで20,000人以上に届けてきた

「実務直結のAIスキル」のノウハウを、

国内外の先端事例と組み合わせ、誰もが再現できる形に体系化したものです。